Ingin mengontrol halaman mana dari website Anda yang boleh dan tidak boleh dirayapi Google? File robots.txt adalah jawabannya. Pada dasarnya, cara setting robots.txt yang benar adalah langkah fundamental dalam technical SEO untuk memberikan instruksi kepada bot mesin pencari. Anggap saja file ini sebagai “rambu lalu lintas” atau “satpam digital” untuk website Anda. Ia memberi tahu bot seperti Googlebot, “Area ini boleh masuk, tapi area itu terlarang.”

Salah konfigurasi bisa berakibat fatal—seluruh website Anda bisa hilang dari Google. Namun jangan khawatir, panduan ini akan membahas tuntas cara setting robots.txt langkah demi langkah, mulai dari fungsi utamanya untuk SEO, sintaks dasar, contoh untuk WordPress, Wix, dan Shopify, hingga cara pengujian yang benar agar website Anda tetap aman dan teroptimasi.

Apa Sebenarnya Fungsi Robots.txt untuk SEO?

Meskipun terlihat sederhana, file robots.txt memiliki peran strategis yang signifikan dalam optimasi SEO. Fungsinya bukan sekadar memblokir, tetapi mengarahkan sumber daya mesin pencari ke tempat yang paling penting.

Mengatur Akses Crawler untuk Optimasi Crawl Budget

Setiap website memiliki alokasi crawl budget atau “anggaran perayapan”. Ini adalah jumlah halaman yang akan dirayapi (di-crawl) oleh cara kerja Googlebot dalam periode waktu tertentu. Untuk website besar dengan ribuan halaman, anggaran ini sangat berharga.

Dengan menggunakan robots.txt, Anda bisa mencegah Googlebot membuang-buang waktu merayapi halaman yang tidak penting (seperti halaman admin, hasil pencarian internal, atau parameter URL yang tak terbatas). Hasilnya, Googlebot akan lebih fokus merayapi dan mengindeks konten-konten utama Anda, yang pada akhirnya akan membantu cara meningkatkan crawlability situs secara keseluruhan.

Mencegah Perayapan Konten Duplikat dan Halaman Privat

Tidak semua halaman di website Anda perlu dilihat oleh Google. Beberapa contoh halaman yang sebaiknya diblokir dari perayapan adalah:

- Halaman Admin: Direktori seperti

/wp-admin/di WordPress tidak relevan untuk pengguna dan tidak seharusnya dirayapi. - Halaman Hasil Pencarian Internal: URL yang dihasilkan dari fitur pencarian di situs Anda (

/?s=keyword) bisa menciptakan ribuan halaman berkualitas rendah. - Halaman Staging atau Development: Versi uji coba dari website Anda yang tidak sengaja bisa terindeks.

- Halaman Thank You atau Konfirmasi: Halaman yang muncul setelah pengguna mengisi form atau melakukan pembelian.

Memblokir halaman-halaman ini membantu mencegah masalah cara mengatasi konten duplikat, yang bisa membingungkan mesin pencari dan melemahkan sinyal peringkat halaman utama Anda.

Mengelola Lalu Lintas Bot untuk Meringankan Beban Server

Setiap kali bot merayapi sebuah halaman, itu sama dengan satu permintaan (request) ke server Anda. Jika perayapan terjadi secara masif dan agresif, terutama pada website besar, ini bisa membebani server dan memperlambat kecepatan website bagi pengguna asli. Dengan robots.txt, Anda bisa mengendalikan lalu lintas bot, yang secara tidak langsung membantu menjaga performa dan cara meningkatkan kecepatan website.

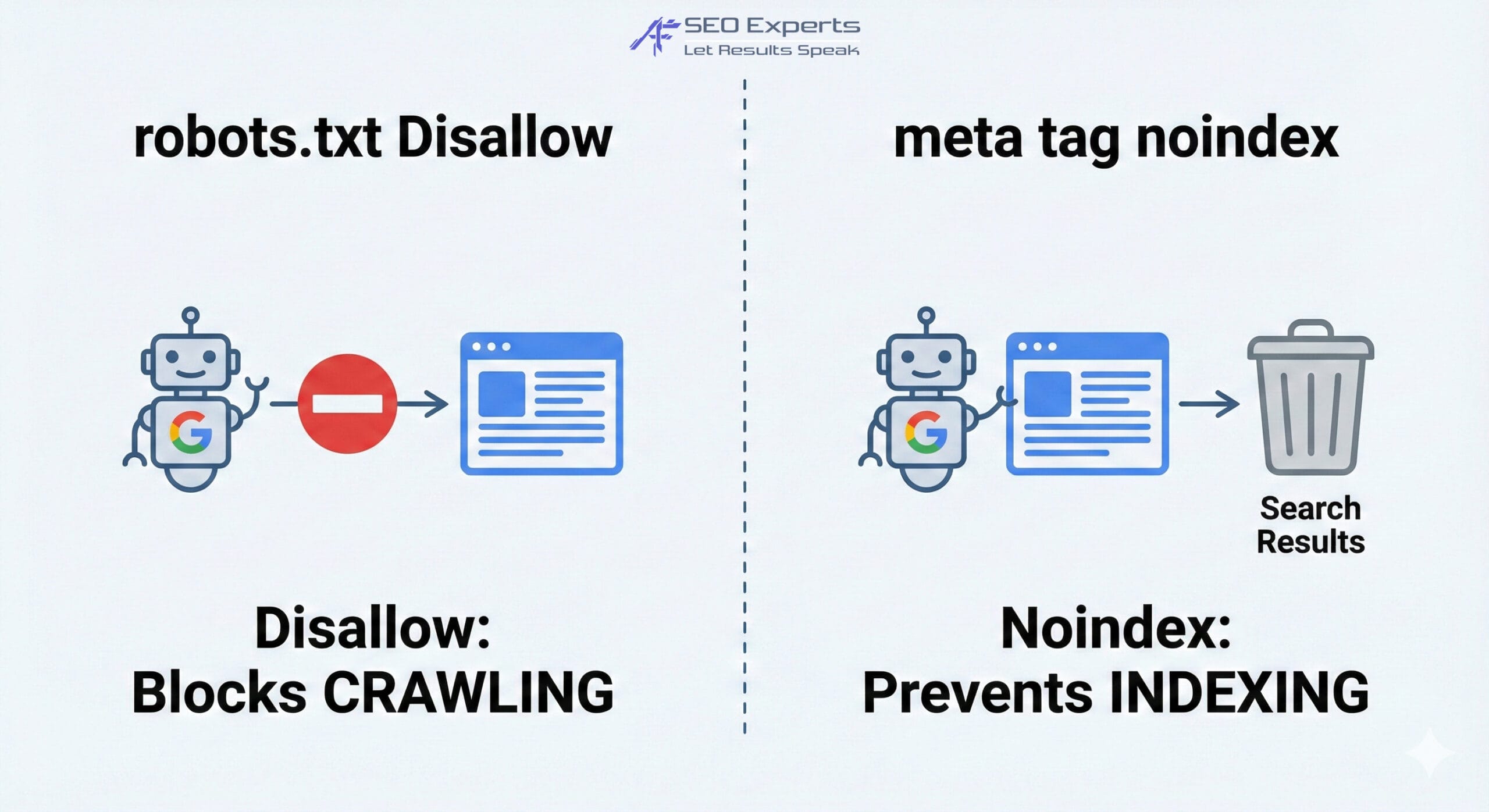

Perbedaan Kunci: Robots.txt vs Meta Tag Noindex

Ini adalah poin paling krusial yang sering disalahpahami.

Disallowdirobots.txthanya melarang CRAWLING (Perayapan). Artinya, Anda hanya menyuruh Google, “Jangan lihat halaman ini.” Namun, jika halaman tersebut memiliki banyak backlink dari situs lain, Google masih bisa MENGINDEKS URL-nya tanpa merayapi isinya. Hasilnya, URL tersebut bisa muncul di hasil pencarian, tetapi tanpa judul dan deskripsi yang jelas.- Meta Tag

noindexmelarang INDEXING (Pengindeksan). Perintah ini ditempatkan di bagian<head>HTML sebuah halaman. Ini adalah cara pasti untuk memberitahu Google, “Saya izinkan Anda melihat halaman ini, tapi tolong jangan pernah menampilkannya di hasil pencarian.”

Aturan Emas: Jika Anda ingin halaman benar-benar hilang dari SERP, gunakan meta tag noindex dan JANGAN memblokirnya di robots.txt. Google perlu merayapi halaman tersebut untuk melihat perintah noindex yang Anda pasang.

Memahami Sintaks dan Arahan (Directives) Dasar Robots.txt

File robots.txt menggunakan aturan sederhana yang disebut directives atau arahan. Mari kita bedah satu per satu.

User-agent: Menentukan Target Bot

Arahan ini digunakan untuk menentukan bot mana yang akan menerima instruksi.

User-agent: *Tanda bintang (*) adalah wildcard yang berarti “semua bot”. Aturan yang mengikuti baris ini berlaku untuk Googlebot, Bingbot, dan semua bot lainnya.User-agent: GooglebotAturan ini hanya berlaku spesifik untuk bot utama Google.User-agent: BingbotAturan ini hanya berlaku untuk bot dari Bing.

Disallow: Memberi Perintah Larangan

Ini adalah arahan yang paling umum, berfungsi untuk melarang bot mengakses file atau direktori tertentu. Path yang ditulis bersifat case-sensitive.

- Contoh:

Disallow: /wp-admin/Melarang bot mengakses folder/wp-admin/dan semua file di dalamnya.

Allow: Memberi Perintah Izin (Pengecualian)

Arahan ini (terutama dipahami oleh Google dan Bing) berfungsi untuk membuat pengecualian. Anda bisa melarang sebuah folder, tetapi mengizinkan akses ke satu file spesifik di dalamnya.

- Contoh:

User-agent: * Disallow: /media/ Allow: /media/public/Aturan di atas melarang bot mengakses seluruh folder

/media/, kecuali untuk sub-folder/media/public/.

Sitemap: Menunjukkan Lokasi Peta Situs

Sangat disarankan untuk menyertakan lokasi sitemap.xml Anda di file robots.txt. Ini membantu bot menemukan semua halaman penting yang ingin Anda indeks dengan lebih efisien.

- Contoh:

Sitemap: https://domainanda.com/sitemap_index.xml

Penggunaan Karakter Khusus: Wildcard (*) dan End-of-URL ($)

- Wildcard (

*): Berfungsi untuk mencocokkan urutan karakter apa pun.- Contoh:

Disallow: /private/*.phpAturan ini akan memblokir semua file yang berakhiran.phpdi dalam folder/private/.

- Contoh:

- End-of-URL (

$): Menandai akhir dari sebuah URL. Berguna untuk lebih spesifik.- Contoh:

Disallow: /*.pdf$Aturan ini akan memblokir semua URL yang berakhiran.pdf, tetapi mengizinkan URL seperti/.pdf-icon/.

- Contoh:

Panduan Langkah-demi-Langkah Membuat dan Setting Robots.txt

Sekarang mari kita praktikkan cara membuat dan memasang file robots.txt di website Anda.

Langkah 1: Buat File Teks dengan Nama robots.txt

- Buka editor teks biasa seperti Notepad (di Windows) atau TextEdit (di Mac).

- Penting: Jangan gunakan pengolah kata seperti Microsoft Word karena bisa menambahkan format tersembunyi yang merusak file.

- Simpan file kosong tersebut dengan nama persis

robots.txt(semua huruf kecil).

Langkah 2: Tulis Aturan Sesuai Kebutuhan

Isi file tersebut dengan arahan yang Anda butuhkan. Berikut adalah beberapa contoh kasus paling umum:

Contoh 1 (Sangat Umum untuk WordPress): Ini adalah konfigurasi dasar yang aman untuk sebagian besar situs WordPress, yang melarang direktori admin tetapi mengizinkan file penting untuk fungsionalitas AJAX.

User-agent: * Disallow: /wp-admin/ Allow: /wp-admin/admin-ajax.php Sitemap: https://domainanda.com/sitemap.xmlContoh 2 (Melarang Semua Bot): Gunakan ini dengan sangat hati-hati, misalnya saat website masih dalam tahap development.

User-agent: * Disallow: /Contoh 3 (Hanya Melarang Satu Direktori): Berguna jika Anda punya folder berisi file-file yang tidak ingin dirayapi.

User-agent: * Disallow: /folder-rahasia/

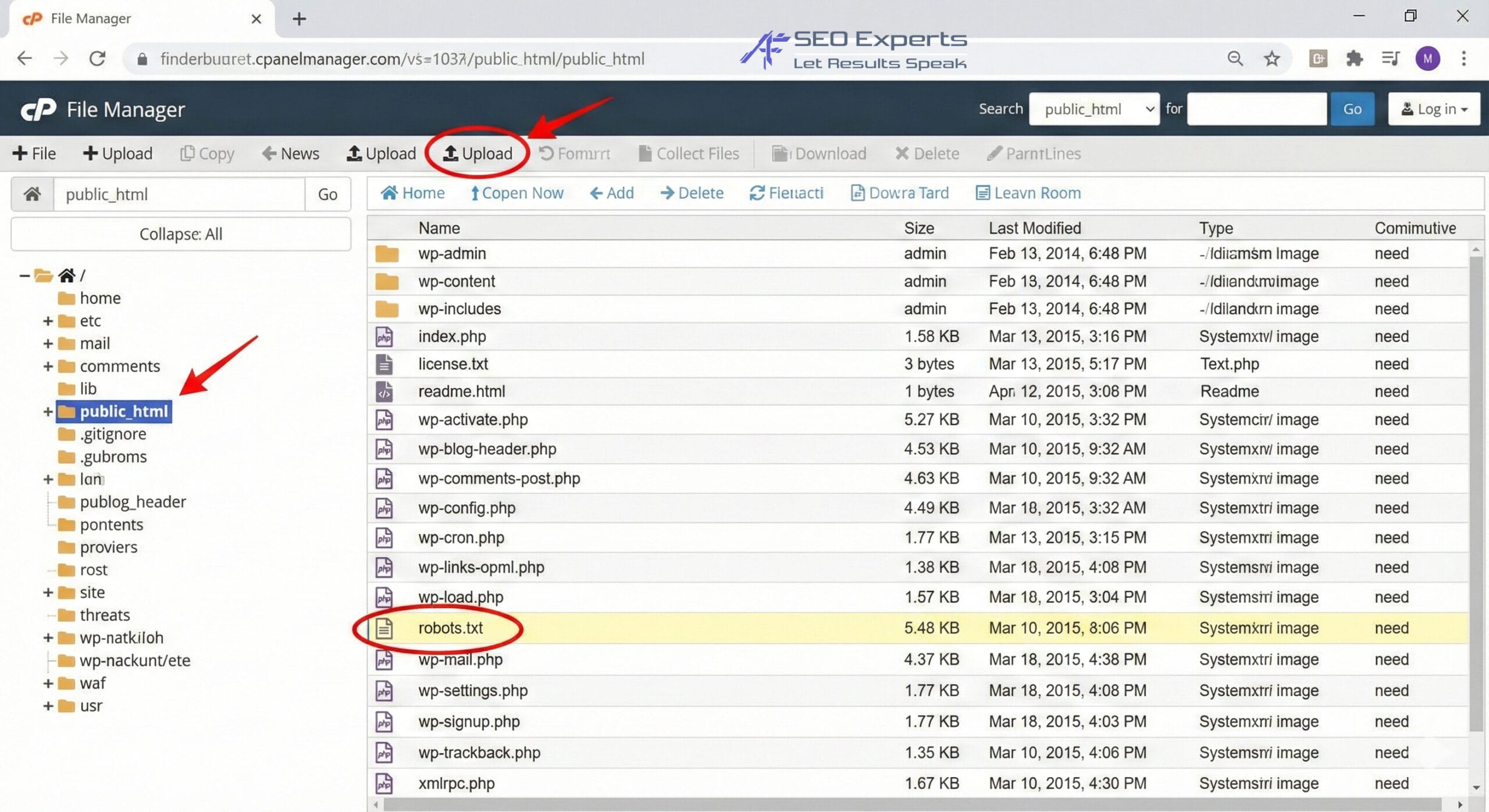

Langkah 3: Unggah File ke Direktori Root Website

File robots.txt harus ditempatkan di direktori root domain Anda agar bisa diakses di domainanda.com/robots.txt. Direktori root biasanya bernama public_html atau www.

Anda bisa mengunggahnya melalui:

- cPanel File Manager: Login ke cPanel hosting Anda, masuk ke File Manager, dan unggah file

robots.txtke dalam folderpublic_html. - FTP Client: Gunakan aplikasi seperti FileZilla untuk terhubung ke server Anda dan unggah file ke direktori root.

Langkah 4: Verifikasi dan Uji File Robots.txt Anda

Setelah diunggah, lakukan dua pengujian penting:

- Cek Akses Publik: Buka browser dan kunjungi

https://domainanda.com/robots.txt. Pastikan isinya sesuai dengan yang Anda tulis. - Gunakan Robots.txt Tester: Masuk ke Google Search Console. Di menu lama, terdapat alat “Robots.txt Tester”. Anda bisa menempelkan konten

robots.txtAnda dan menguji apakah URL tertentu diblokir atau diizinkan untuk Googlebot. Ini adalah cara terbaik untuk memastikan tidak ada kesalahan fatal.

Cara Setting Robots.txt di Berbagai Platform (WordPress, Shopify, Wix)

Setiap platform memiliki cara pengelolaan robots.txt yang sedikit berbeda.

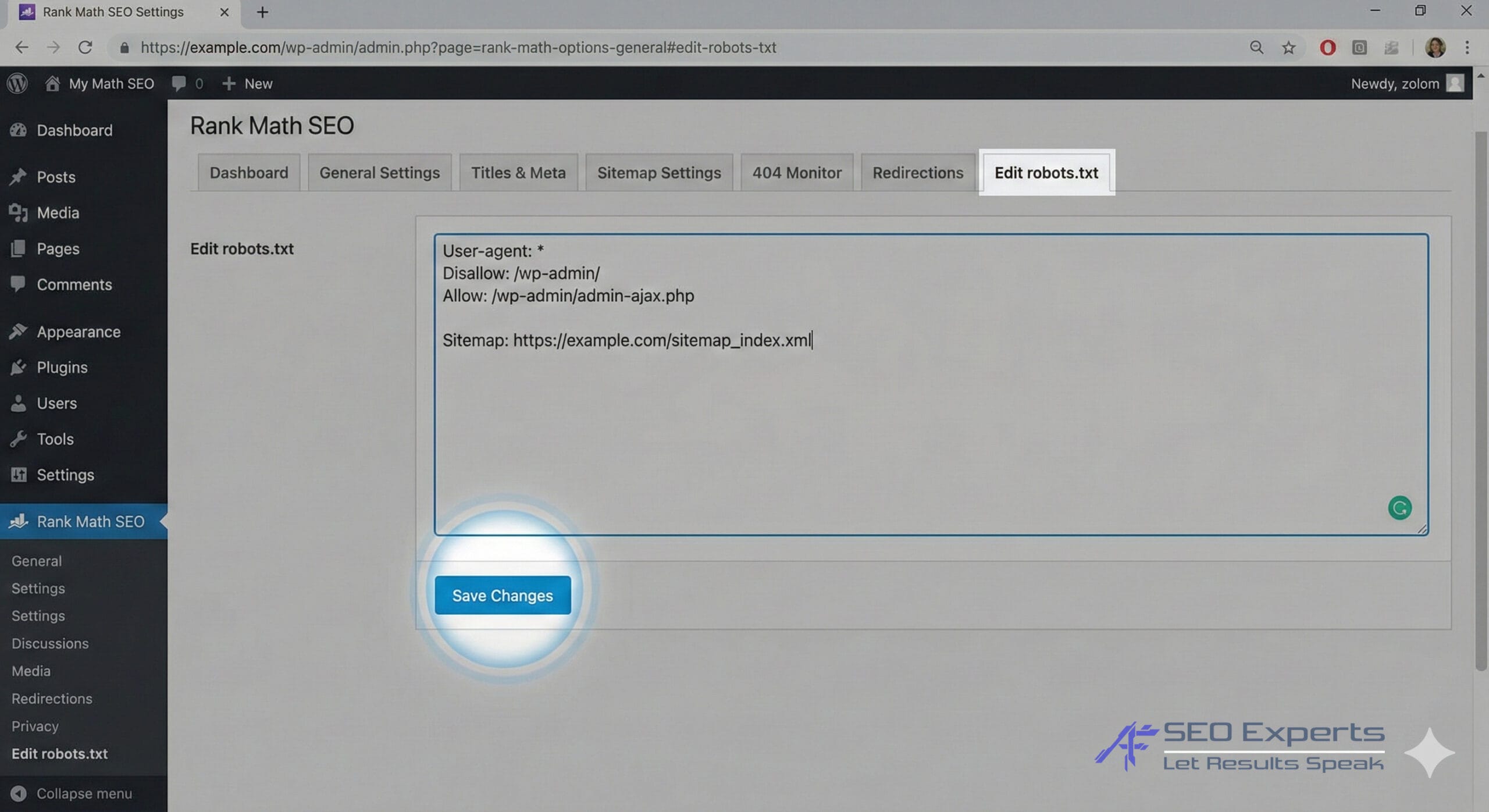

Pengguna WordPress (Cara Paling Mudah)

Metode Plugin (Disarankan): Jika Anda menggunakan plugin SEO seperti Yoast SEO atau Rank Math, ini adalah cara teraman.

- Untuk Rank Math: Buka menu Rank Math > General Settings > Edit robots.txt.

- Untuk Yoast SEO: Buka menu Yoast SEO > Tools > File editor. Anda bisa langsung menulis atau mengubah aturan

robots.txtdari dashboard WordPress tanpa perlu akses cPanel/FTP.

Metode Manual: Jika Anda tidak menggunakan plugin SEO, ikuti Langkah 3 di atas untuk mengunggah file secara manual melalui cPanel atau FTP.

Pengguna Shopify

Shopify membuat file robots.txt secara otomatis dan tidak bisa diedit secara langsung. File ini sudah dioptimalkan untuk struktur Shopify, misalnya dengan memblokir halaman keranjang belanja dan checkout.

Solusi: Jika Anda ingin mencegah halaman tertentu (misalnya halaman koleksi yang belum siap) terindeks, Anda tidak bisa menggunakan robots.txt. Sebagai gantinya, gunakan metode noindex dengan mengedit file tema theme.liquid Anda untuk menambahkan meta tag noindex pada halaman yang ditargetkan.

Pengguna Wix

Sama seperti Shopify, Wix juga mengelola robots.txt secara default. Namun, Wix memberikan fleksibilitas lebih. Anda dapat menambahkan aturan custom dari dashboard.

- Buka Dashboard > Marketing & SEO > SEO Tools.

- Pilih Robots.txt File.

- Di sini, Anda bisa melihat file default dan menambahkan arahan

DisallowatauAllowAnda sendiri.

Kesalahan Umum yang Harus Dihindari & Praktik Terbaik

Sedikit kesalahan ketik bisa berdampak besar. Berikut adalah hal-hal yang wajib Anda hindari.

Kesalahan Fatal: Tidak Sengaja Menulis Disallow: /

Arahan Disallow: / berarti “blokir semua halaman di seluruh situs”. Ini akan membuat website Anda hilang total dari hasil pencarian Google. Selalu periksa kembali setiap karakter, terutama tanda /.

Kesalahan Umum: Memblokir File CSS dan JavaScript

Dulu, banyak orang memblokir folder yang berisi file CSS dan JS untuk menghemat crawl budget. Ini adalah praktik yang sangat salah saat ini. Google perlu merayapi file-file ini untuk merender halaman seperti yang dilihat pengguna. Memblokirnya akan membuat Google tidak bisa memahami layout dan fungsionalitas halaman Anda, yang berakibat buruk pada peringkat.

Kesalahan Konsep: Menggunakan Disallow untuk Menyembunyikan Halaman

Seperti yang sudah dijelaskan, Disallow bukan cara untuk menyembunyikan halaman dari indeks Google. Jika ada URL yang sudah terindeks dan Anda ingin menghapusnya, gunakan meta tag noindex atau hapus halaman tersebut dan ajukan penghapusan URL melalui Google Search Console.

Praktik Terbaik: Selalu Uji Sebelum dan Sesudah Mengubah File

Setiap kali Anda mengubah file robots.txt, sekecil apa pun, selalu gunakan Robots.txt Tester di Google Search Console untuk memvalidasi aturannya. Pastikan Anda tidak secara tidak sengaja memblokir halaman penting atau mengizinkan halaman privat.

Topik Lanjutan: Cara Memblokir Bot AI (Seperti ChatGPT)

Dengan maraknya AI generatif, banyak pemilik website khawatir konten mereka digunakan untuk melatih model AI tanpa izin. File robots.txt menjadi garda terdepan untuk mencegah hal ini. Ini adalah langkah proaktif untuk melindungi properti intelektual Anda dan mengontrol bagaimana data Anda dimanfaatkan oleh perusahaan AI.

Kenapa Anda Perlu Memblokir Bot AI?

Alasan utamanya adalah kontrol data. Perusahaan AI seperti OpenAI (pembuat ChatGPT) dan Google menggunakan bot untuk merayapi web secara masif, menyerap informasi untuk melatih Large Language Models (LLMs) mereka. Proses ini sering disebut sebagai scraping. Dengan memblokir bot mereka, Anda mengirimkan sinyal jelas bahwa Anda tidak memberikan izin bagi konten Anda untuk digunakan sebagai bahan pelatihan. Meskipun robots.txt bersifat anjuran, perusahaan teknologi besar yang bereputasi baik umumnya mematuhi aturan ini untuk menghindari potensi masalah hukum dan etika. Bagi kreator konten, penulis, dan bisnis yang mengandalkan keunikan informasinya, ini adalah cara untuk menjaga nilai dari karya mereka.

Contoh Aturan untuk Memblokir Bot AI Populer

Anda bisa menambahkan blok arahan baru yang spesifik untuk bot-bot AI ini. Berikut adalah contoh untuk memblokir GPTBot dari OpenAI dan Google-Extended, bot Google yang digunakan untuk melatih model AI seperti Gemini.

# Blokir bot dari OpenAI

User-agent: GPTBot

Disallow: /

# Blokir bot AI dari Google

User-agent: Google-Extended

Disallow: /

Dengan menambahkan aturan ini ke file robots.txt Anda, Anda secara efektif meminta bot-bot tersebut untuk tidak merayapi bagian mana pun dari situs Anda. Anda bisa menempatkan blok ini di mana saja di dalam file, baik di awal maupun di akhir.

Kesimpulan

Menguasai cara setting robots.txt adalah keahlian esensial bagi siapa pun yang serius mengelola website. File ini adalah alat yang powerful untuk mengarahkan bot mesin pencari, mengoptimalkan crawl budget, dan menjaga agar bagian-bagian privat dari situs Anda tidak dirayapi.

Ingatlah selalu poin-poin terpenting: robots.txt adalah untuk mengelola perayapan (crawling), bukan untuk keamanan atau mencegah pengindeksan (indexing). Untuk mencegah halaman muncul di Google, meta tag noindex adalah senjata utama Anda. Selalu berhati-hati, teliti setiap baris, dan lakukan pengujian setelah melakukan perubahan sekecil apa pun.

Sekarang, coba cek file robots.txt di website Anda. Apakah sudah terkonfigurasi dengan benar? Jika belum ada, ikuti langkah-langkah di atas untuk membuatnya sekarang!

Merasa pusing dengan aspek teknis seperti robots.txt, sitemap, atau kecepatan website? Anda tidak sendirian. Optimasi teknis adalah fondasi dari peringkat #1 di Google, dan seringkali menjadi bagian paling rumit.

Saya, Achmad Farid, bersama tim saya siap membantu Anda membangun fondasi SEO yang kokoh. Kami tidak hanya memperbaiki robots.txt, tetapi juga melakukan audit menyeluruh untuk memastikan setiap aspek teknis website Anda bekerja secara maksimal untuk mendatangkan traffic dan konversi.

Jangan biarkan kesalahan teknis kecil menghalangi potensi besar bisnis Anda. Klik tombol di bawah ini untuk konsultasi SEO gratis dan mari kita bahas bagaimana kami bisa membawa website Anda ke puncak Google.